Robert Sombrutzki

Computer- und Medienservice, Digitale Infrastruktur und Betrieb

Der Computer- und Medienservice hat mit HPC@HU ein innovatives High-Performance-Computing-Angebot bereitgestellt. Wie wird das Hochleistungsrechnen von den Forschenden und Lehrenden an der HU angenommen? Und wie wird es sich künftig entwickeln?

Claudia Aera im Gespräch mit Robert Sombrutzki, Teamleiter HPC am CMS

Herr Sombrutzki, können Sie uns einen Überblick über das HPC-Angebot des CMS geben?

Der Service HPC@HU bietet für Forschungsgruppen und die Lehre an der HU einen Zugang zu leistungsfähigen Rechenressourcen und entsprechendem Speicherplatz. Die Betreuung und Weiterentwicklung des Services erfolgt durch das HPC-Team, welches aus vier Mitarbeiter:innen besteht.

Der Cluster von HPC@HU besteht zurzeit aus 35 Compute-Knoten, die jeweils mit zwei 64-Kern-CPUs von AMD ausgestattet sind. In 30 Servern davon sind GPUs und 1 TB RAM verbaut. Fünf Systeme sind ohne GPUs, aber mit mehr RAM (4 TB) ausgestattet.

Welche Infrastruktur steht den Nutzenden zur Verfügung?

Auf dem Cluster läuft eine Virtualisierung (OpenStack), die es ermöglicht, Nutzenden einzelne virtuelle Rechner, aber auch komplette Infrastrukturen wie z. B. Kubernetes-Cluster zur Verfügung zu stellen (Infrastruc-tur-as-a-Service; IaaS). Die Softwarekomponente Azimuth vereinfacht die Benutzung des Systems, indem die Nutzenden über eine Weboberfläche unter verschiedenen Plattformen auswählen können und einen einfachen Zugang zum System erhalten. Des Weiteren wird von Azimuth auch ein Monitoring für die Plattformen eingerichtet, sodass die Nutzenden z. B. die Auslastungen ihrer Plattformen im Blick behalten können.

Über Azimuth werden den Nutzenden zudem verschiedene Plattformen wie ein Desktop, JupyterHub, aber auch Kubernetes- und Slurm-Cluster angeboten. Zusätzlich stehen verschiedene Softwarepakete wie R-Studio, Matlab oder Ollama zur Verfügung. Durch dieses breite Angebot an Plattformen und Softwarepaketen kann der Service den unterschiedlichen Anforderungen aus den vielen Fachrichtungen der HU gerecht werden.

Wie wird HPC von Forschenden und Lehrenden an der HU genutzt?

Derzeit nutzen 230 Mitarbeiter:innen aus 33 Projekten den Service. Die Fachbereiche sind dabei sehr vielfältig. Neben den klassischen HPC-Nutzer:innen wie Informatik, Physik und Chemie gibt es auch Projekte aus anderen Bereichen wie den Wirtschafts- und Sozialwissenschaften.

Die Nutzung unterscheidet sich entsprechend stark. Während klassische HPC-Nutzer:innen direkt Job-Scheduler wie Slurm benutzen, beginnen andere Fachrichtungen meist mit einem Desktop oder Einzelanwendungen wie R-Studio und JupyterHub, um zunächst Programme zu entwickeln und kleinere Datensätze zu bearbeiten. Im Verlauf wechseln diese je nach Anwendung auf größere Infrastrukturen wie Slurm und Kubernetes (k8s).

Steht den Nutzenden Support zur Verfügung?

Das HPC-Team unterstützt die Projekte von Anfang an, indem schon zu Beginn gemeinsam mit den Nutzer:innen über das Projekt und die Ziele gesprochen wird und passende Infrastrukturen und Softwarepakete vorgeschlagen werden. Das Team unterstützt auch bei der Einrichtung und Installation von Plattformen und Softwarepaketen.

Können Sie konkrete Anwendungsbeispiele beschreiben?

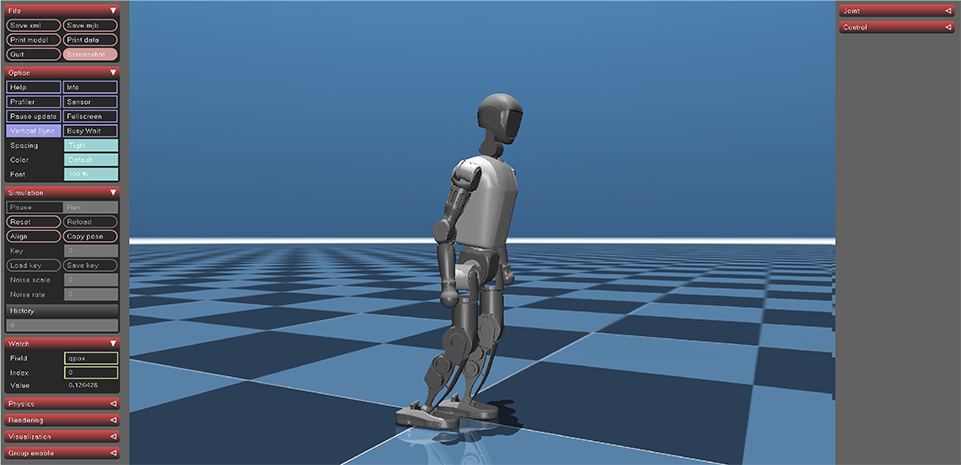

Der Lehrstuhl für Adaptive Systeme aus dem Fachbereich Informatik nutzt den HPC-Service bspw., um mit maschinellem Lernen das Laufen für humanoide Roboter zu trainieren. Dies geschieht in einem Simulator (Abb. 1) und wird dort auch getestet. Es kommen dabei sogenannte Reinforcement-Learning-Algorithmen zum Einsatz und es werden leistungsfähige GPUs benötigt.

In einem weiteren Projekt entwickelt das Albrecht Daniel Thaer-Institut für Agrar- und Gartenbauwissenschaften mit Hilfe eines innovativen Bildanalyseansatzes Methoden für die Pflanzenforschung und -züchtung. Dazu werden aus einem Datensatz, der in einem Hochdurchsatz-Phänotypisierungsgewächshaus erhoben wurde, digitalisierte Simulationen der Pflanzenarchitektur und Lichtabsorption abgeleitet. Es soll auch untersucht werden, wie die Pflanzdichte die Architektur und das Gewicht der Pflanzenkrone beeinflusst.

In einem Projekt des Instituts für Bibliotheks- und Informationswissenschaft wird wiederum untersucht, wie die Verwendung schwieriger ungewöhnlicher Cover-Versionen von Musikstücken im Training die Robustheit von Modellen zur automatisierten Erkennung von Cover-Versionen verbessern kann. Dabei werden z. B. Amateur-Cover, instrumentale und Karaoke-Versionen für das Training von audiobasierten Modellen benutzt.

Hierzu werden leistungsfähige GPUs mit viel RAM benötigt. Die Projekte haben unterschiedliche Anforderungen, aber die eigenen Ressourcen reichten jeweils nicht aus, um die Anwendungen überhaupt bzw. in kurzer Zeit laufen zu lassen. HPC@HU konnte die entsprechenden Ressourcen wie GPU, RAM und CPU in größerem Umfang sowie die benötigte Software und Plattform zur Verfügung stellen.

Wie ist der Dienst ausgelastet?

Seit Beginn des Testbetriebs ist die Anzahl der Nutzenden von HPC@HU stetig gestiegen. Insbesondere Projekte aus der Chemie und Physik benötigen umfangreiche HPC-Ressourcen. Insgesamt sind die Server meist zu ca. 70 % ausgelastet (Abb. 2). Es sind aber noch Ressourcen für weitere Projekte verfügbar.

Auch im Hinblick auf den Speicherplatz gibt es noch freie Kapazität. Im Moment sind 30 % der zur Verfügung stehenden 1,6 PetaByte belegt. Das HPC-Team arbeitet bereits an der Möglichkeit, Daten im größeren Umfang auf Band zu archivieren, sodass vorübergehend nicht benötigte Daten ausgelagert werden können.

Woran arbeitet das Team aktuell noch?

Der Fokus liegt auf der Konfiguration und Anpassung des Systems an die Anforderungen der Nutzenden. Ein wichtiger Baustein ist dabei die Installation weiterer neuer Softwarepakete, die für die einzelnen Projekte benötigt werden. Diese werden teilweise vom HPC-Team unter Berücksichtigung spezieller Wünsche gebaut. Das ist häufig erforderlich, um das Zusammenspiel einzelner Softwareprodukte untereinander und mit der Eigenentwicklung der Projekte sicherzustellen.

Eine weitere Herausforderung ist die Leistungsverbesserung des Systems. So wird es im Dezember 2025 ein Update des Filesystems geben, um sowohl die Stabilität und Leistung zu verbessern als auch mit der neuen Version weitere Optionen im Hinblick auf die Konfiguration zu erhalten. Dadurch kann den Projekten einfacher und flexibler Speicherplatz zur Verfügung gestellt werden, der dann auch über mehrere Plattformen hinweg nutzbar ist.

Zukünftig soll es mehr Workshops geben, in denen das HPC-Team die Möglichkeiten des Services anhand von Beispielprojekten aufzeigt. Hierbei sollen die verschiedenen Plattformen und die enthaltenen Softwareprodukte vorgestellt werden. Den Nutzenden bietet sich so auch die Möglichkeit, ihre Projekte kurz vorzustellen und mit dem HPC-Team gemeinsam mögliche Wege zur Umsetzung zu diskutieren.

Wie wird sich das Angebot in Zukunft entwickeln?

In 2025 wurden die Server mit weiteren GPUs ausgestattet, um insbesondere GPU-Anwendungen mehr Ressourcen zur Verfügung stellen zu können. Entsprechend werden auch die Softwareangebote erweitert und z. B. Compiler installiert, die durch Features wie GPU-Offloading die Nutzung von GPUs deutlich vereinfachen.

Neben dem bestehenden Lustre-Speicher soll es, wie gesagt, auch die Möglichkeit geben, große Datenmengen auf Tapes zu archivieren. Dies kann u. a. von Projekten genutzt werden, die nach Abschluss den benutzten Speicher auf dem HPC-System freigeben möchten, die Daten jedoch für folgende Projekte oder zur Reproduzierbarkeit aufbewahren wollen.

Im Januar 2026 findet sich das HPC-Userboard zu einem ersten Treffen zusammen. Dabei werden die Mitglieder der einzelnen Fakultäten und Institute gemeinsam die weiteren zukünftigen Bedarfe der Projekte zusammentragen, und diskutieren, wie das Angebot von HPC@HU weiterentwickelt werden soll.